cd /opt/linuxsir

tar -zxvf hadoop-2.7.3.tar.gz

ls

mv hadoop-2.7.3 /opt/linuxsir/hadoop

在192.168.31.131虚拟机上编辑/root/.bashrc文件,然后复制到192.168.31.132、192.168.31.133

echo "" >> /root/.bashrc

echo "export HADOOP_PREFIX=/opt/linuxsir/hadoop" >> /root/.bashrc

echo "export HADOOP_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_COMMON_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_CONF_DIR=$HADOOP_PREFIX/etc/hadoop" >> /root/.bashrc

echo "export HADOOP_HDFS_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_MAPRED_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export HADOOP_YARN_HOME=$HADOOP_PREFIX" >> /root/.bashrc

echo "export PATH=$PATH:$HADOOP_PREFIX/sbin:$HADOOP_PREFIX/bin" >> /root/.bashrc

echo "export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib/native"" >> /root/.bashrc

echo "export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native" >> /root/.bashrc

echo "export CLASSPATH=$CLASSPATH:/opt/linuxsir/hadoop/lib/*" >> /root/.bashrc

cat /root/.bashrc

\在192.168.31.131上,复制/root/.bashrc到132和133

scp -r /root/.bashrc root@192.168.31.132:/root/.bashrc

scp -r /root/.bashrc root@192.168.31.133:/root/.bashrc

\在192.168.31.131上,在131/132/133三台机器上运行/root/.bashrc,刷新环境

cd

source /root/.bashrc

ssh root@192.168.31.132 source /root/.bashrc

ssh root@192.168.31.133 source /root/.bashrc

cd /opt/linuxsir/hadoop \进入/opt/linuxsir/hadoop目录

rm -rf /opt/linuxsir/hadoop/tmp

rm -rf /opt/linuxsir/hadoop/hdfs

mkdir /opt/linuxsir/hadoop/tmp \创建tmp目录

mkdir -p /opt/linuxsir/hadoop/hdfs/data /opt/linuxsir/hadoop/hdfs/name \创建hdfs的data、name子目录

\还要针对hd-slave1,hd-slave2等两个节点上执行上述命令,然后再初始化hdfs

ssh root@192.168.31.132 rm -rf /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.132 rm -rf /opt/linuxsir/hadoop/hdfs

ssh root@192.168.31.132 mkdir /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.132 mkdir -p /opt/linuxsir/hadoop/hdfs/data /opt/linuxsir/hadoop/hdfs/name

ssh root@192.168.31.133 rm -rf /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.133 rm -rf /opt/linuxsir/hadoop/hdfs

ssh root@192.168.31.133 mkdir /opt/linuxsir/hadoop/tmp

ssh root@192.168.31.133 mkdir -p /opt/linuxsir/hadoop/hdfs/data /opt/linuxsir/hadoop/hdfs/name

对若干配置文件进行设置,保证Hadoop能够正常启动。

(1) 主要的配置文件包括HADOOP_HOME目录下的

(2) 并且为如下文件配置环境变量

(3)master和slave

编辑/opt/linuxsir/hadoop/etc/hadoop目录下的core-site.xml文件

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:///opt/linuxsir/hadoop/tmp</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hd-master:9000</value><!-- NameNode URI -->

</property>

<property>

<name>io.file.buffer.size</name>

<value>131702</value>

</property>

</configuration>

编辑/opt/linuxsir/hadoop/etc/hadoop目录下的hdfs-site.xml文件,内容如下

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///opt/linuxsir/hadoop/hdfs/name</value> <!-- 本机name目录for NameNode -->

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///opt/linuxsir/hadoop/hdfs/data</value> <!-- 本机data目录for DataNode -->

</property>

<property>

<name>dfs.replication</name> <!-- 数据块副本数量 -->

<value>2</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hd-master:9001</value>

</property>

</configuration>

在/opt/linuxsir/hadoop/etc/hadoop目录下,复制mapred-site.xml.template到mapred-site.xml,并且进行编辑

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value> <!--yarn or yarn-tez-->

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>hd-master:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hd-master:19888</value>

</property>

<property>

<name>mapreduce.map.memory.mb</name> <!-- memory for map task -->

<value>64</value>

</property>

<property>

<name>mapreduce.reduce.memory.mb</name> <!-- memory for reduce task -->

<value>128</value>

</property>

<property>

<name>mapreduce.task.io.sort.mb</name>

<value>32</value>

</property>

<property>

<name>mapreduce.map.java.opts</name> <!-- settings for JVM map task -->

<value>-Xms128m -Xmx256m</value>

</property>

<property>

<name>mapreduce.reduce.java.opts</name> <!-- settings for JVM reduce task -->

<value>-Xms128m -Xmx256m</value>

</property>

</configuration>

在/opt/linuxsir/hadoop/etc/hadoop编辑yarn-site.xml文件,对YARN资源管理器的ResourceManager和NodeManagers节点、端口、内存分配等进行配置

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hd-master</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>hd-master:9032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>hd-master:9030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>hd-master:9031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>hd-master:9033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>hd-master:9099</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.app.mapreduce.am.resource.mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.app.mapreduce.am.command-opts</name>

<value>-Xms128m -Xmx256m</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>8</value>

</property>

<property>

<name>yarn.nodemanager.resource.cpu-vcores</name>

<value>1</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

</configuration>

进入hadoop-env.sh脚本文件所在目录/opt/linuxsir/hadoop/etc/Hadoop

export JAVA_HOME=/opt/linuxsir/java/jdk

接着,设置/opt/linuxsir/hadoop/etc/hadoop目录下yarn-env.sh脚本文件的JAVA_HOME变量,内容如下

export JAVA_HOME=/opt/linuxsir/java/jdk

如果NodeManager因为内存不足,而启动不起来,那么yarn-env.sh文件需要做如下修改,即JAVA_HEAP_MAX改为3G

JAVA_HEAP_MAX=-Xmx3072m

修改/opt/linuxsir/hadoop/etc/hadoop/masters文件和/opt/linuxsir/hadoop/etc/hadoop/slaves文件,目的是指定主节点和从节点列表。

/opt/linuxsir/hadoop/etc/hadoop/masters文件的内容如下,即主节点为hd-master

hd-master

/opt/linuxsir/hadoop/etc/hadoop/slaves文件的内容如下,即从节点为hd-slave1和hd-slave2

hd-slave1

hd-slave2

从192.168.31.131虚拟机复制Hadoop到其它各个节点,包括192.168.31.132、192.168.31.133。 在192.168.31.131上运行如下命令

chmod a+rwx -R /opt/linuxsir \设置/opt/linuxsir的存取权限

ssh root@192.168.31.132 chmod a+rwx -R /opt/linuxsir

ssh root@192.168.31.133 chmod a+rwx -R /opt/linuxsir

scp -r /root/.bashrc root@192.168.31.132:/root/.bashrc \复制/root/.bashrc

scp -r /root/.bashrc root@192.168.31.133:/root/.bashrc

scp -r /opt/linuxsir/hadoop hd-slave1:/opt/linuxsir \复制/opt/linuxsir/hadoop

scp -r /opt/linuxsir/hadoop hd-slave2:/opt/linuxsir

source ~/.bashrc \刷新环境变量

ssh root@192.168.31.132 source ~/.bashrc

ssh root@192.168.31.133 source ~/.bashrc

这里分享一个你一定用得到的小程序——CDA数据分析师考试小程序。

它是专为CDA数据分析认证考试报考打造的一款小程序。可以帮你快速报名考试、查成绩、查证书、查积分,通过该小程序,考生可以享受更便捷的服务。

扫码加入CDA小程序,与圈内考生一同学习、交流、进步!

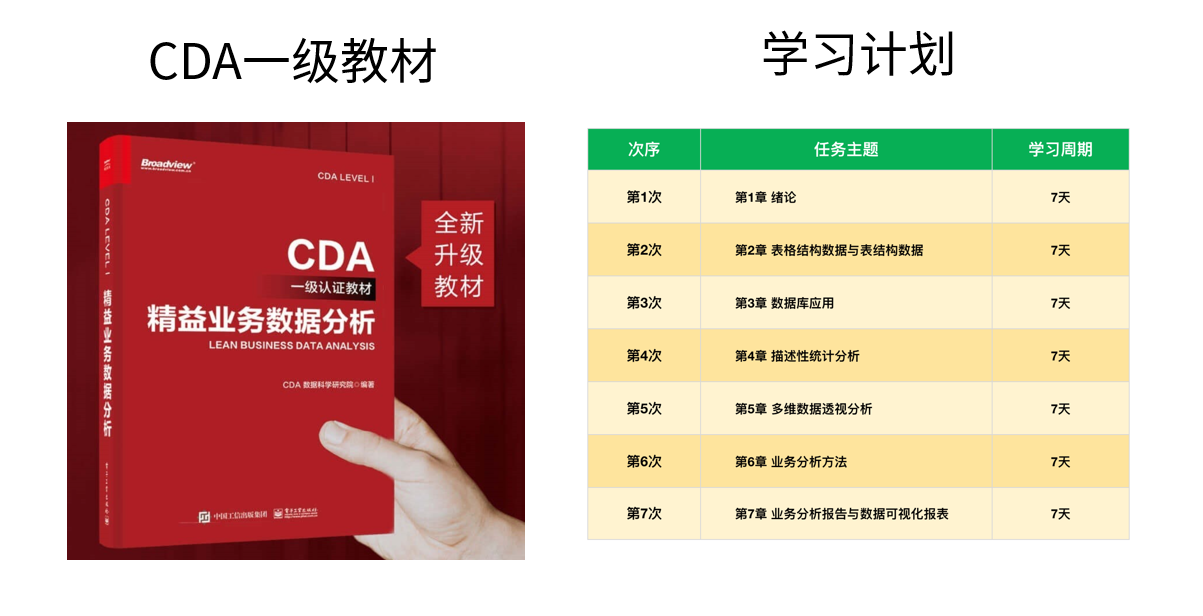

《CDA一级教材》适合CDA一级考生备考,也适合业务及数据分析岗位的从业者提升自我。完整电子版已上线CDA网校,累计已有10万+在读~

免费加入阅读:https://edu.cda.cn/goods/show/3151?targetId=5147&preview=0

数据分析咨询请扫描二维码

若不方便扫码,搜微信号:CDAshujufenxi

持证人简介:贺渲雯 ,CDA 数据分析师一级持证人,互联网行业数据分析师 今天我将为大家带来一个关于用户私域用户质量数据分析 ...

2025-04-18一、CDA持证人介绍 在数字化浪潮席卷商业领域的当下,数据分析已成为企业发展的关键驱动力。为助力大家深入了解数据分析在电商行 ...

2025-04-17CDA持证人简介:居瑜 ,CDA一级持证人,国企财务经理,13年财务管理运营经验,在数据分析实践方面积累了丰富的行业经验。 一、 ...

2025-04-16持证人简介: CDA持证人刘凌峰,CDA L1持证人,微软认证讲师(MCT)金山办公最有价值专家(KVP),工信部高级项目管理师,拥有 ...

2025-04-15持证人简介:CDA持证人黄葛英,ICF国际教练联盟认证教练,前字节跳动销售主管,拥有丰富的行业经验。在实际生活中,我们可能会 ...

2025-04-14在 Python 编程学习与实践中,Anaconda 是一款极为重要的工具。它作为一个开源的 Python 发行版本,集成了众多常用的科学计算库 ...

2025-04-14随着大数据时代的深入发展,数据运营成为企业不可或缺的岗位之一。这个职位的核心是通过收集、整理和分析数据,帮助企业做出科 ...

2025-04-11持证人简介:CDA持证人黄葛英,ICF国际教练联盟认证教练,前字节跳动销售主管,拥有丰富的行业经验。 本次分享我将以教培行业为 ...

2025-04-11近日《2025中国城市长租市场发展蓝皮书》(下称《蓝皮书》)正式发布。《蓝皮书》指出,当前我国城市住房正经历从“增量扩张”向 ...

2025-04-10在数字化时代的浪潮中,数据已经成为企业决策和运营的核心。每一位客户,每一次交易,都承载着丰富的信息和价值。 如何在海量客 ...

2025-04-09数据是数字化的基础。随着工业4.0的推进,企业生产运作过程中的在线数据变得更加丰富;而互联网、新零售等C端应用的丰富多彩,产 ...

2025-04-094月7日,美国关税政策对全球金融市场的冲击仍在肆虐,周一亚市早盘,美股股指、原油期货、加密货币、贵金属等资产齐齐重挫,市场 ...

2025-04-08背景 3月26日,科技圈迎来一则重磅消息,苹果公司宣布向浙江大学捐赠 3000 万元人民币,用于支持编程教育。 这一举措并非偶然, ...

2025-04-07在当今数据驱动的时代,数据分析能力备受青睐,数据分析能力频繁出现在岗位需求的描述中,不分岗位的任职要求中,会特意标出“熟 ...

2025-04-03在当今数字化时代,数据分析师的重要性与日俱增。但许多人在踏上这条职业道路时,往往充满疑惑: 如何成为一名数据分析师?成为 ...

2025-04-02最近我发现一个绝招,用DeepSeek AI处理Excel数据简直太爽了!处理速度嘎嘎快! 平常一整天的表格处理工作,现在只要三步就能搞 ...

2025-04-01你是否被统计学复杂的理论和晦涩的公式劝退过?别担心,“山有木兮:统计学极简入门(Python)” 将为你一一化解这些难题。课程 ...

2025-03-31在电商、零售、甚至内容付费业务中,你真的了解你的客户吗? 有些客户下了一两次单就消失了,有些人每个月都回购,有些人曾经是 ...

2025-03-31在数字化浪潮中,数据驱动决策已成为企业发展的核心竞争力,数据分析人才的需求持续飙升。世界经济论坛发布的《未来就业报告》, ...

2025-03-28你有没有遇到过这样的情况?流量进来了,转化率却不高,辛辛苦苦拉来的用户,最后大部分都悄无声息地离开了,这时候漏斗分析就非 ...

2025-03-27